Revue Droits et libertés

Publiée deux fois par année, la revue Droits et libertés permet d’approfondir la réflexion sur différents enjeux de droits humains. Réalisée en partenariat avec la Fondation Léo-Cormier, la revue poursuit un objectif d’éducation aux droits.

Chaque numéro comporte un éditorial, les chroniques Un monde sous surveillance, Ailleurs dans le monde, Un monde de lecture, Le monde de l’environnement, Le monde de Québec, un dossier portant sur un thème spécifique (droits et handicaps, droits des personnes aînées, police, culture, droit à l’eau, profilage, mutations du travail, laïcité, etc.) ainsi qu’un ou plusieurs articles hors-dossiers qui permettent de creuser des questions d’actualité. Les articles sont rédigés principalement par des militant-e-s, des représentant-e-s de groupes sociaux ou des chercheuses ou chercheurs.

Créée il y a 40 ans, la revue était d’abord diffusée aux membres de la Ligue des droits et libertés. Depuis, son public s’est considérablement élargi et elle est distribuée dans plusieurs librairies et disponible dans certaines bibliothèques publiques.

Bonne lecture !

Le droit à l’éducation en tant que droit humain

Le droit à l'éducation en tant que droit humain

Retour à la table des matières Droits et libertés, automne 2023 / hiver 2024

Christine Vézina, Professeure, Faculté de droit de l’Université Laval, directrice et chercheure principale de COMRADES – Communauté de recherche-action sur les droits économiques et sociaux Le droit à l’éducation est un droit de la famille des droits économiques, sociaux et culturels, protégé par les articles 13 et 14 du Pacte international relatif aux droits économiques, sociaux et culturels (PIDESC)1 ratifié par le Québec et le Canada en 1976. Comme tous les droits humains, le droit à l’éducation impose des obligations de respect, de protection et de mise en œuvre à la charge de l’État2. Conformément à ses engagements, le gouvernement du Québec doit donc s’abstenir d’agir de manière à porter atteinte au droit, réglementer l’action du secteur privé afin qu’il se conforme aux obligations imposées par le droit à l’éducation et enfin adopter, de manière délibérée, des lois, des politiques publiques et des programmes et les financer suffisamment, afin de donner effet audit droit.

Un droit d’autocapacitation

La singularité du droit à l’éducation repose sur le fait qu’il est un droit d’autocapacitation, c’est-à-dire un droit destiné à donner du pouvoir aux personnes et « une des clefs des autres droits inhérents à la personne humaine3». En misant sur l’épanouissement « de la personnalité humaine » et « du sens de sa dignité », le droit à l’éducation vise à permettre à toutes et tous de participer à « une société libre », en y jouant un « rôle utile »4. C’est l’article 13(1) du PIDESC qui consacre explicitement cette idée, se conjuguant au présent et au futur. On détecte en effet, au cœur du droit à l’éducation, une double temporalité qui lui est propre. Le droit vise à miser sur le présent, tout en formulant un projet d’avenir où les groupes diversifiés de la société se comprennent. En nous invitant ainsi à rêver au futur, on peut dire que le droit à l’éducation est porteur d’espoir. Il l’est aussi par son humanisme qui dépasse, selon le Comité des droits économiques sociaux et culturels (CDESC), la finalité utilitariste que l’on peut associer à l’éducation : « son importance ne tient pas uniquement aux conséquences [qu’a l’éducation] sur le plan pratique. Une tête bien faite, un esprit éclairé et actif capable de vagabonder librement est une des joies et des récompenses de l’existence5 ». La visée d’autocapacitation du droit à l’éducation a aussi une portée transformative dans le sens où elle cherche à permettre aux adultes et aux enfants socialement et économiquement marginalisés de se doter des moyens leur permettant d’être actrices et acteurs de leur communauté. Pour atteindre cet objectif aux bienfaits collectifs, il importe pour l’État de concevoir les fonds affectés à l’éducation comme « un des meilleurs investissements financiers que l’État puisse réaliser6 » plutôt que comme des dépenses.Quatre caractéristiques essentielles et interdépendantes

Pour concrétiser ces précieux objectifs poursuivis par le droit à l’éducation, quatre caractéristiques essentielles et interdépendantes doivent structurer l’intervention de l’État : la dotation, l’accessibilité, l’acceptabilité et l’adaptabilité, le tout devant être surdéterminé par l’intérêt supérieur de l’apprenant7. Ces exigences imposent de prévoir des établissements, des programmes et des services éducatifs disponibles, en nombre suffisant, qui soient accessibles sur les plans physique et économique, sans discrimination. Ces établissements, programmes et services doivent être acceptables pour les personnes, c’est-à-dire qu’ils doivent être de bonne qualité, pédagogiquement pertinents et culturellement appropriés. Ils doivent aussi être souples et adaptés aux besoins des étudiant-e-s et des sociétés en mutation. Ces caractéristiques forment en quelque sorte des vecteurs d’effectivité du droit à l’éducation.Du minimum au maximum des ressources disponibles

L’État dispose d’une certaine marge de manœuvre pour réaliser progressivement le droit à l’éducation, tout en ayant l’obligation de mobiliser l’ensemble des ressources disponibles pour lui donner effet8. Ce volet de ses obligations est toutefois trop souvent instrumentalisé pour invisibiliser les obligations à réalisation immédiate qui s’imposent à lui et pour justifier indûment des atteintes au droit. Il importe donc de bien démêler les différents types d’obligations prévus au PIDESC. Au chapitre des obligations à réalisation immédiate, soit les obligations dont la réalisation ne peut être différée dans le temps, se trouvent celles qui visent à assurer la jouissance du noyau minimal essentiel du droit. Ce seuil minimal fondamental, en deça duquel il est impossible d’aller, exige l’accès gratuit et universel à l’éducation primaire, des programmes éducatifs qui visent les objectifs humanistes poursuivis par l’article 13(1) du PIDESC, l’adoption et la mise en œuvre d’un programme national d’éducation visant l’enseignement secondaire, universitaire et l’éducation de base, accompagné d’indicateurs destinés à l’évaluer9 et le libre choix de l’éducation sans ingérence de l’État10. L’interdiction de discrimination dans l’accès aux établissements, programmes et services s’impose également de manière immédiate, à titre de composante du noyau minimal essentiel11. L’appréciation des obligations à réalisation progressive, quant à elle, est tributaire du niveau de richesse de l’État. Essentiellement, plus l’État est riche et moins il peut s’exonérer des atteintes au droit qui découlent de son inaction. Dans tous les cas, l’exigence de progressivité n’est pas synonyme d’inaction12. En effet, l’État est tenu d’agir de manière immédiate dans le but d’assurer l’éducation secondaire, universitaire et l’éducation de base. Il est de plus reconnu que la collecte de données ventilées13, permettant de mieux comprendre les réalités et de déceler la discrimination, s’impose à l’État dès la ratification du PIDESC. Enfin, le pendant de l’obligation à réalisation progressive se manifeste dans l’interdiction de mesures régressives, lesquelles ne peuvent s’avérer justifiées que dans des circonstances limitées et exceptionnelles14.Des voies de recours effectifs

Comme pour tous les droits prévus au PIDESC, l’État est tenu de prévoir des voies de recours en cas d’atteinte au droit protégé, à défaut de quoi il doit démontrer qu’il ne s’agit pas de mesures appropriées pour donner effet au droit15.Ces recours doivent prévoir des réparations pour les victimes d’atteintes attribuables à l’action et à l’omission de l’État et, à la fois, forcer son imputabilité.À ce titre, il importe de rappeler que le Canada a accepté la dernière recommandation formulée par le Conseil des droits de l’homme, dans le cadre de l’examen périodique universel, exigeant qu’il cesse de demander à ses procureur-e-s de plaider l’injusticiabilité des droits économiques, sociaux et culturels16. Ce bref survol nous a permis de tracer les contours du droit à l'éducation tel qu'il existe en droit international des droits humains. Comme nous l’avons vu, ce droit impose une diversité d’obligations à l’État et forme un cadre d’analyse à partir duquel il est possible de jeter un regard critique sur le système d’éducation québécois et ses failles. À l’heure du système à trois vitesses, de la médicalisation de l’éducation et des bris de scolarisation, de la scolarisation partielle et précaire des élèves handicapés ou en difficulté d’apprentissage ou d’adaptation, il ne fait aucun doute que la grille du droit à l’éducation peut présenter un atout pour catégoriser les atteintes au droit et ainsi, inscrire le comportement de l’État dans un rapport juridique qui exige de la bonne foi, de l’imputabilité, de la transparence, du suivi et de l’évaluation fondés sur des données ventilées et, lorsque requis, des réparations.

- Pacte international relatif aux droits économiques, sociaux et culturels, 16 décembre 1966, 993 RTNU 3 à l’art 16 (entrée en vigueur : 3 janvier 1976, adhésion par le Canada le 19 août 1976) [PIDESC].

- CDESC, CDESC, Observation générale 13. Le droit à l’éducation (art. 13 du Pacte), Doc off CES NU, 21e sess. DOC NU E/C.12/1999/10, par. 46 [Observation générale no 13].

- Id., par. 1

- PIDESC, art. 13(1).

- Observation générale no.13, par. 1.

- Id.

- Id., par. 6 et 7.

- PIDESC, art. 2(1); CDESC, Observation générale no 3 : La nature des obligations des États parties, Doc off CES NU, 5e sess, Doc NU E/1991/23 (1990) par. 1, 2, 9, 10, 11, 12, 13 [Observation générale no 3]; Observation générale 13, par. 43. Notons que les Observations finales du CDESC à l’égard du Canada, formulées lors de la dernière évaluation du pays dans le cadre du suivi de la mise en œuvre du PIDESC, en 2016, recommandait explicitement au Canada de mettre en place une politique fiscale équitable permettant de mobiliser les ressources disponibles requises pour donner effet aux droits économiques, sociaux et culturels. CDESC, Observations finales concernant le 6e rapport périodique du Canada, Doc off CES NU, 57e sess, Doc NU E/C.12/CAN/CO/6, par. 7 et 8 [Observations finales relatives au Canada de 2016].

- Observation générale no. 13, par. 52.

- Id., par. 51.

- Id., par. 57.

- Id., par. 44.

- Id., par. 37.

- Id., par 45.

- PIDESC, 2(1); CDESC, Observation générale no. 3, par. 5.

- Recommandation réitérée par le CDESC dans ses dernières observations finales à l’égard du Observations finales relatives au Canada de 2016, par. 5 et 6.

L’article Le droit à l’éducation en tant que droit humain est apparu en premier sur Ligue des droits et libertés.

La vie sociale des droits

La vie sociale des droits

Diane Lamoureux, Professeure émérite en science politique de l'Université Laval et membre du CA de la LDLRetour à la table des matières Revue Droits et libertés, printemps / été 2023

Des revendications aux droits

La plupart des droits qui figurent dans nos Chartes ont commencé sous la forme de revendications. Prenons l’exemple du droit de vote. Celui-ci émerge, en Occident, de la remise en cause de la souveraineté absolue des monarques et de la volonté de faire participer, de façon plus ou moins importante, les populations aux décisions qui les concernent. Le cheminement a été long, de l’obligation pour les monarques de consulter les grands barons du royaume sur certains sujets tel qu’énoncé dans la Grande Charte de 1215 en Angleterre, en se poursuivant dans les réflexions des philosophes politiques sur la souveraineté et la citoyenneté entre les XVIe et XVIIIe siècle, en passant par la révolte des colons étasuniens au nom du no taxation without representation ou par la Révolution française et l’énoncé que la souveraineté ne peut résider que dans le peuple. Une fois le principe du vote acquis, restait à savoir qui avait le droit de vote. Cela a donné lieu, en Grande-Bretagne, au mouvement chartiste réclamant le droit de vote pour tous les hommes adultes; aux mouvements suffragistes des femmes un peu partout dans les pays occidentaux; aux mouvements de décolonisation et pour l’instauration d’États indépendants en Afrique et en Asie, au mouvement contre l’apartheid en Afrique du Sud et aux luttes contre les dictatures un peu partout sur la planète. La codification du droit de vote universel pour les adultes dans la Déclaration universelle des droits de l’Homme (DUDH) en 1948 n’a pas mis un point final à la lutte pour le droit de vote. Face aux dictatures, on a pu voir émerger des mouvements citoyens pour des élections libres. Le mouvement étasunien des droits civiques des années 1950 et 1960 demandait l’inscription des personnes noires sur les listes électorales pour qu’elles aient la possibilité d’exercer le droit de vote. Malgré le Voting Act de 1965, les campagnes pour l’inscription sur les listes électorales, contre le gerrymandering1, et pour un nombre suffisant de bureaux de vote se poursuivent encore aujourd’hui chez nos voisins du sud. La situation n’est guère plus reluisante au Canada et au Québec, puisque les femmes ont longtemps été exclues du droit de vote2 et qu’elles ont dû mener une longue campagne pour enfin obtenir ce droit : à titre d’exemple, au Québec, les suffragistes ont présenté (via un député favorable) des projets de loi en faveur du suffrage féminin sans succès, tous les ans, entre 1922 et 1939.Des chartes ou des déclarations, pour quoi faire?

Depuis la fin du 18e siècle, il est devenu coutumier de codifier les droits dans un texte solennel. Plus récemment, les Nations Unies, dans la foulée de l’adoption de la DUDH en 1948, se sont dotées d’une panoplie d’instruments de droits humains qui précisent ou complètent cette déclaration3 dont le Pacte international relatif aux droits civils et politiques (1966), le Pacte international relatif aux droits économiques, sociaux et culturels (1966), la Convention pour l’élimination des discriminations à l’égard des femmes (1979). Au Québec nous avons une Déclaration des droits de la personne (devenue depuis Charte québécoise des droits et libertés de la personne) depuis 1975 et le Canada a ajouté une Charte des droits lors du rapatriement de la constitution en 1982. Il faut également ajouter des déclarations régionales comme la Déclaration américaine des droits et des devoirs de l’Homme (1948) ou encore locales comme la Charte montréalaise des droits et des responsabilités (2006). On pourrait se demander à quoi servent tous ces instruments de défense des droits humains au regard de l’empressement des divers gouvernements à les bafouer ou à les contourner en adoptant des législations ayant recours à une clause de dérogation comme cela a été le cas récemment au Québec avec les projets de loi 21 et 96 ou en Ontario pour prévenir une grève dans le milieu de l’éducation4. En fait tous ces instruments sont utiles. En codifiant les principes autour desquels devrait s’organiser le vivre-ensemble des sociétés, elles stimulent les luttes pour la mise en œuvre de ces droits là où ils sont bafoués, puisqu’elles permettent aux populations de confronter leurs gouvernements à respecter leurs engagements internationaux en matière de droits humains. Elles permettent également d’en appeler des discriminations de certains gouvernements devant une autre instance, comme c’est le cas dans l’Union européenne en vertu de la Déclaration européenne des droits de l’Homme; ainsi les droits des personnes LGBTQ+ dans beaucoup d’États européens ont été validés par la Cour européenne de justice avant d’être intégrés dans les législations nationales de plusieurs pays de l’Union. Elles permettent aussi d’étendre certains droits à des groupes pour lesquels ils n’étaient pas prévus. Ainsi, la clause d’interdiction de la discrimination de la Charte québécoise a pu s’appliquer à l’orientation sexuelle ou encore au handicap, ce qui n’était pas prévu à l’origine. C’est aussi de cette façon que les femmes ont pu obtenir le droit de vote dans plusieurs pays et, plus récemment, de fragiles droits reproductifs.De nouvelles générations de droit

On peut également soutenir que les droits appellent de nouveaux droits. Au point de départ, les droits reconnus étaient essentiellement civils ou politiques. Les mobilisations des mouvements ouvriers et des mouvements féministes ont fait en sorte que beaucoup de droits sociaux s’ajoutent à ces droits civils et politiques. Voudrait-on vivre aujourd’hui dans une société où le droit de grève ou le droit à la santé ou à l’éducation ne sont pas reconnus5? La spéculation immobilière et la rareté des logements disponibles nous rappellent par ailleurs l’urgence d’inscrire le droit au logement dans nos Chartes. Les enjeux écologiques alimentent également diverses mobilisations pour des droits qui ne sont pas encore reconnus comme le droit à l’eau potable, à un air respirable, à la protection des territoires ou des paysages. Ils soulèvent également de nouvelles questions concernant les droits. Doit-on conférer des droits aux animaux non humains ou encore à l’ensemble des êtres vivants? Les enjeux liés aux migrations internationales font aussi l’objet de luttes concernant les droits. Certains États européens cherchent actuellement à criminaliser comme passeurs les personnes qui fournissent leur aide aux migrant-e-s irréguliers, par exemple en les recueillant à bord de bateaux en Méditerranée. Quels doivent être les droits à la migration des populations dont l’habitat est détruit du fait des changements climatiques? Doit-on élargir le droit d’asile pour y inclure l’asile lié à des conditions socio-économiques?Penser en termes de vie sociale des droits

Le fait que les droits naissent dans les revendications sociales et parviennent parfois à être codifiés dans des Chartes, lesquelles nourrissent de nouvelles mobilisations sociales pour en exiger le respect, les étendre à des groupes sociaux pour lesquels ils n’étaient pas prévus ou obtenir de nouveaux droits qui en découlent m’amène à réfléchir en termes de vie sociale des droits. Cette notion, qui a été développée d’abord dans les milieux anthropologiques, présente plusieurs avantages. D’abord, elle permet de dépasser une version ossifiée des droits qui devraient être légalement codifiés pour exister. Ensuite, elle rend possible de prendre en compte l’ensemble des acteurs en cause dans le milieu des droits humains qui sont loin de se limiter aux communautés juridiques. Elle permet également de reconnaître le caractère toujours localisé et ancré dans les luttes sociales des droits humains. Enfin, elle permet d’échapper aux débats universalisme/relativisme culturel en les ancrant à la fois dans les pratiques concrètes des groupes sociaux qui s’en saisissent, mais en les rattachant à des luttes pluriséculaires un peu partout sur la planète.- Découpage partisan de la carte électorale.

- Au Canada, les femmes ont obtenu le droit de vote après la Première Guerre mondiale, le droit de vote fédéral, en Les Québécoises n’ont obtenu le droit de vote au provincial qu’en 1940. Les Autochtones (hommes et femmes) vivant dans les réserves n’obtiennent le droit de vote qu’en 1969. Les premières élections municipales montréalaises au suffrage universel ont lieu en 1970. Quant aux personnes détenues, elles devront attendre 1979 pour obtenir le droit de vote au Québec et en 2004 au Canada.

- En voici la liste complète selon le site des Nations Unies : la Convention internationale pour l’élimination de toutes les formes de discrimination raciale (1965), le Pacte international relatif aux droits civils et politiques (1966), le Pacte international relatif aux droits économiques, sociaux et culturels (1966), la Convention pour l’élimination des discriminations à l’égard des femmes (1979), la Convention relative aux droits de l’enfant (1989), la Convention contre la torture et autres peines et traitements cruels, inhumains ou dégradants (1984), la Convention internationale sur la protection des droits de tous les travailleurs migrants et de leur famille (1990), la Convention relative aux droits des personnes handicapées (2006), la Convention internationale pour la protection de toutes les personnes contre les disparitions forcées (2006). La Déclaration des Nations Unies sur les droits des peuples autochtones a été adoptée en 2007, mais ne jouit pas du même statut que les autres textes.

- La Charte canadienne est enchâssée dans la Constitution et ne peut être amendée que selon les procédures d’amendement de la Constitution. Par contre, la Charte québécoise peut être modifiée en tout temps par un projet de loi recueillant l’assentiment d’une majorité simple des membres de l’Assemblée nationale.

- Même si les droits économiques et sociaux ne sont pas justiciables au même titre que les droits civils et politiques.

L’article La vie sociale des droits est apparu en premier sur Ligue des droits et libertés.

Lutter pour le droit à l’égalité effective

Retour à la table des matières Revue Droits et libertés, printemps / été 2023

Lutter pour le droit à l'égalité effective

Martine Éloy, militante à la LDL et membre du CA de 2002 à 2022Les années 1963 à 2000

Victoire majeure de la Ligue des droits et libertés (LDL) : en 1975, après une dizaine d’années de pressions et de revendications, la Charte des droits et libertés de la personne du Québec a finalement été adoptée à l’unanimité par l’Assemblée nationale. Pour une première fois au Québec, les droits fondamentaux étaient enchâssés dans un document juridique ! Au cours des premières décennies de son existence, l’intervention de la LDL sur la question du racisme a pris la forme de dénonciations des discriminations et d’appuis à des luttes menées par des groupes victimes de discrimination, notamment celle des chauffeur-euse-s de taxi haïtien-ne-s, et celles de réfugié-e-s et sans-statut, dont Victor Regalado et Mohamed Cherfi. La LDL a aussi été très active en appui aux Autochtones engagé-e-s dans la lutte pour leurs droits, comme dans la guerre du saumon. Dès les années 1980, tout en poursuivant son travail terrain de dénonciations des discriminations, la LDL s’est penchée sur la montée des mouvements d’extrême-droite néonazis et des violences racistes au Québec1, jetant ainsi les bases d’une analyse systémique du racisme.Les années 2000 et la guerre au terrorisme

Les attentats du 11 septembre 2001 ont donné lieu dans les pays occidentaux à une déferlante d’islamophobie. L’horreur de l’attentat a été instrumentalisée pour réactiver les stéréotypes associés aux mondes musulman et arabe, omniprésents dans la culture occidentale, et les répandre allègrement dans l’espace public. Les manifestations de gestes racistes ne se sont pas fait attendre, avec des conséquences directes, inquiétantes et bouleversantes pour les populations concernées : discrimination en matière d’emploi et de logement, agressions verbales et physiques envers les femmes portant le voile, profilage racial dans l’application des mesures antiterroristes dont les listes d’interdiction de vol et les certificats de sécurité, et de nombreuses autres. La LDL a alors initié un projet d’observatoire pour documenter et dénoncer ce néo-racisme ou racisme culturel. En effet, l’attribution à un groupe, présenté comme homogène, d’une identité culturelle stéréotypée, considérée inférieure et irréconciliable avec la culture dominante, constitue une forme de racisme.2007 et après : Charte des valeurs et laïcité de l’État

Le climat de peur savamment entretenu par les gouvernements après le 11 septembre a favorisé la montée d’un racisme décomplexé dans le discours public. Cette période du discours du EUX contre NOUS a ouvert grande la porte au discours identitaire construit autour des soi-disant valeurs québécoises aux dépens des personnes musulmanes ou perçues comme telles. Il y a d’abord eu tout le débat public autour des accommodements raisonnables qui a donné lieu à la Commission Bouchard-Taylor en 2007. À cette occasion, la LDL a déposé un mémoire et témoigné aux audiences, rappelant que les mesures d’accommodement ont comme objectif de lutter contre l’exclusion en favorisant l’intégration d’un individu ayant un besoin spécifique (mobilité, santé, religion). La LDL a alors réitéré que tous les droits sont interdépendants et ne peuvent donc pas être hiérarchisés. Les conclusions du rapport Bouchard-Taylor ont été ignorées et, à la suite de ce rapport, nous avons plutôt eu droit à une série de projets de loi discriminatoires visant les minorités religieuses et particulièrement les femmes musulmanes : PL 942, PL 60 (Charte des valeurs)3, PL 624 et le PL 215. Pendant cette période, la LDL a émis nombre de communiqués, lettres ouvertes et mémoires, arguant que la majorité ne peut priver une minorité de droits garantis par les chartes des droits au nom des soi-disant valeurs de la majorité. En fait, le discours sur les valeurs communes est un discours d’exclusion. La LDL a aussi publié Laïcité, un fascicule qui a été réimprimé à quatre reprises entre 2010 et 2019. L’objectif était d’arriver à une compréhension commune du concept de laïcité, qui a été développé pour protéger les groupes de croyances minoritaires et non pour imposer une non-croyance. Tous les projets de loi ci-dessus ont échoué à être adoptés, sauf le PL 216, promulguée par la Coalition avenir Québec (CAQ) sous le bâillon en 2019.Fredy Villanueva et la lutte contre le profilage racial

L’usage abusif de la force, notamment envers des jeunes racisés, et le profilage qui le sous-tend ont toujours été dans la mire de la LDL. Le 9 août 2008, Fredy Villanueva, un jeune de 18 ans, a été abattu par un policier alors qu’il était avec un groupe de jeunes qui jouaient aux dés dans un parc à Montréal-Nord. Lors de l’intervention policière qui dura moins d’une minute, deux autres jeunes ont aussi été blessés par les tirs du policier. Le sentiment d’injustice ressenti face à cet incident d’une violence inouïe a engendré une importante mobilisation contre les violences policières dont sont particulièrement victimes les personnes racisées. La LDL a participé activement à une coalition qui réclamait une enquête publique pour faire la lumière, non seulement sur les causes et circonstances de cette mort, mais aussi sur l’impunité policière et le traitement que la police réserve aux personnes racisées et marginalisées. Cet évènement a relancé la mobilisation pour dénoncer le profilage racial et les abus policiers.2016 : Le racisme est systémique

En 2016, à l’initiative de groupes racisés, une vaste coalition s’est constituée pour demander que le gouvernement tienne une consultation publique sur le racisme systémique. Dans ce contexte, les membres de la LDL, réuni-e-s en AGA, ont décidé, sur recommandation du comité Racisme, laïcité et exclusion sociale, de faire de la lutte au racisme une priorité et ont endossé l’approche systémique du racisme.Au-delà des comportements individuels, des propos vexatoires et des gestes discriminatoires, il y a des facteurs et des pratiques organisationnelles, institutionnelles et sociétales qui ont des effets discriminatoires pérennes pour les personnes racisées.Pour la LDL, à la suite du constat que le droit formel n’est pas suffisant pour combattre un système, il est devenu apparent qu’il est important de s’attaquer aux causes structurelles du racisme. C’est dans cet esprit que la LDL a déposé un mémoire en 20197 et participé aux audiences de l’Office de consultation publique de Montréal (OCPM) sur le racisme et la discrimination systémiques. Certaines des recommandations de la LDL figurent d’ailleurs dans le rapport final de la Ville de Montréal. La LDL a appuyé l’appel à la création d’une commission sur le racisme systémique au Québec et a produit une brochure en 2016, Le racisme systémique… parlons-en!, permettant de mieux comprendre ce terme souvent galvaudé et mal interprété, y compris par le premier ministre lui-même. Depuis, la LDL a multiplié les occasions pour faire connaître le concept du racisme systémique auprès de publics francophones et anglophones d’abord par la publication d’une brochure qui a circulé à plus de 10 000 exemplaires ; d’un numéro de la revue Droits et libertés ; d’ateliers publics et privés ; de webinaires ; de capsules vidéo en animation ; des carnets des militant-e-s et, en 2022, d’une 2e édition révisée de la brochure.

2020 à 2023 : La pandémie révélatrice des iniquités

La pandémie de COVID-19 a mis en lumière ce qu’on on savait déjà : nous ne sommes pas tous et toutes égales, même face à la maladie. Pour les personnes racisées notamment dans les quartiers du nord-est de Montréal, l’éloignement des services médicaux, les conditions d’emplois précaires dans des secteurs jugés essentiels, le caractère exigu des logements qui ne permettent pas la distanciation et l’impossibilité de s’absenter pour se faire vacciner sont tous des facteurs qui expliquent un taux de décès supérieur à ceux de la plupart des autres quartiers de Montréal. C’est un exemple éloquent de l’interdépendance des droits : lorsque le droit à l’égalité est bafoué, cela porte à atteinte à d’autres droits, tel le droit à la santé et à la vie. Le traitement subi par Joyce Echaquan au Centre hospitalier De Lanaudière est malheureusement un autre exemple de l’existence du racisme sociétal au Québec et plus largement au Canada. Il est urgent de reconnaître l’existence du racisme systémique, car on ne peut espérer vaincre un problème dont on nie l’existence. Le droit à l’égalité est au cœur de notre mission et la LDL s’engage à poursuivre son intervention dans la poursuite de la lutte pour une société où le droit à l’égalité de tous et toutes sera une réalité.- Ces travaux ont mené à la publication du livre Les Skins Heads et l’extrême droite, VLB Éditeur, 1991.

- Gouvernement du Québec, Projet de loi no 94, Loi établissant les balises encadrant les demandes d’accommodement, 2010.

- Gouvernement du Québec, Projet de loi no 60, Charte affirmant les valeurs de laïcité et de neutralité religieuse de l’État, 2013.

- Gouvernement du Québec, Projet de loi no 62, Loi favorisant le respect de la neutralité religieuse de l’État et visant notamment à encadrer les demandes d’accommodements pour un motif religieux dans certains organismes, 2017.

- Gouvernement du Québec, Projet de loi no 21, Loi sur la laïcité de l’État, 2019.

- LDL, Le projet de loi 21 : un projet de loi discriminatoire et contraire aux principes fondamentaux d’un État de droit, mai 2019.

- Ligue des droits et libertés, Opinion écrite déposée à l’Office de consultation publique de Montréal, 31 octobre 2019, https ://liguedesdroits.ca/la-ville-de-montreal-possede-les-outils-necessaires-pour-contrer-le-racisme-systemique/

L’article Lutter pour le droit à l’égalité effective est apparu en premier sur Ligue des droits et libertés.

L’éducation au coeur des possibilités

Retour à la table des matières Droits et libertés, automne 2023 / hiver 2024

Laurence Guénette, coordonnatrice de la Ligue des droits et libertés Prenons un instant pour réfléchir à ce qu’est l’éducation, non pas au sens technique et disciplinaire, mais au sens sociétal, philosophique et en tant que droit humain. L’éducation est une condition essentielle à la participation de la population à la vie collective et politique. À notre époque particulièrement trouble, elle constitue une clé de voûte pour combattre le marasme et l’apathie qui menacent de freiner les luttes sociales. Elle nourrit à la fois l’épanouissement personnel et l’émancipation collective, elle alimente les débats et les mobilisations que nous n’avons pas le luxe de délaisser. L’éducation, au sens large où l’entendait Paulo Freire, pédagogue brésilien, est un moyen subversif de transformer le monde dans lequel on vit. L’éducation se trouve au coeur de la possibilité que nous avons de résoudre les crises actuelles dans une perspective de justice sociale. Comme l’énonce l’Organisation des Nations unies pour l’éducation, la science et la culture (UNESCO), l’éducation se doit d’être « l’un des outils les plus puissants pour permettre aux enfants et aux adultes marginalisés sur le plan économique et social de s’extraire de la pauvreté et de participer pleinement à la société1 ». La Ligue des droits et libertés s’est penchée à quelques reprises sur le droit à l’éducation, mettant en relief les obligations des États pour en assurer le respect. L’exercice de ce droit est intimement lié à l’exercice d’autres droits, un caractère d’interdépendance qu’il est essentiel de reconnaitre. En guise d’exemple, une personne ne jouissant pas d’une éducation accessible et adaptée aux besoins de sa communauté sera moins à même d’accéder à la justice si ses droits sont bafoués par son employeur ou son locateur ; de bien comprendre la posologie d’un médicament dont elle a besoin ; de sortir de la précarité et d’exercer son droit à un niveau de vie suffisant, etc. Par ses engagements en matière de droits humains et du Pacte international des droits économiques, sociaux et culturels (PIDESC), le gouvernement du Québec doit respecter, protéger et mettre en oeuvre le droit à l’éducation. Comme le rappelle Christine Vézina, l’une des autrices de ce dossier, « [le gouvernement du Québec] doit donc s’abstenir d’agir de manière à porter atteinte au droit, réglementer l’action du secteur privé afin qu’il se conforme aux obligations imposées par le droit à l’éducation et enfin adopter, de manière délibérée, des lois, des politiques publiques et des programmes et les financer suffisamment, afin de donner effet audit droit ». Les portes de l’éducation et des connaissances ne sont-elles pas grandes ouvertes depuis les années 1960, quand le Québec a fait le choix de garantir à toutes et tous l’accès à l’éducation ? Pourtant, les constats provenant notamment des mouvements sociaux sont déplorables ; des facteurs économiques, géographiques, sociaux et culturels constituent des obstacles structuraux multiples et empêchent de nombreuses personnes d’accéder pleinement à une éducation émancipatrice tout au long de la vie. Au moment d’écrire ces lignes, les rues sont animées par la grève des enseignantes à boutte et de tout le personnel scolaire et de soutien à travers la province, qui malgré l’épuisement, sont déterminé-e-s à défendre l’école publique. Il se trouve que l’État se désengage progressivement des services publics depuis de nombreuses années, et qu’actuellement, le système scolaire public reflète fort dramatiquement les conséquences de cette tendance. Telle qu’abordée dans cette édition de Droits et libertés, l’éducation va bien au-delà du droit à l’éducation tel que consacré par le droit international des droits humains. En plus de l’éducation formelle, elle englobe l’éducation au sens informel et non formel, populaire et citoyenne, déclinaisons essentielles de toutes ces façons par lesquelles l’être humain peut rendre son monde intelligible et y participer pleinement et en toute liberté. L’éducation formelle, celle qui se transmet via un parcours scolaire classique, est bien entendu fondamentale, mais elle ne peut se substituer aux formes plus horizontales, participatives, communautaires, voire contestataires, qui contribuent à façonner et à protéger les communautés, en créant des collectivités inclusives dotées d’un filet social réel et complet. Avec cette édition de la revue, nous proposons de réfléchir au rôle de l’éducation, abordée dans son sens très vaste, pour donner force à la dignité de chaque personne et à l’épanouissement de chaque communauté, à la promotion des droits humains, à la lutte contre les inégalités et la pauvreté, au respect des diversités (culturelle, sociale, politique…), à la citoyenneté et à la solidarité. Les liens entre l’éducation et les droits humains sont nombreux et riches. Nous donnons voix dans ces pages à des auteurs et autrices en mesure de témoigner de diverses situations mettant en péril le droit à l’éducation, et d’initiatives déployant des formes inclusives et transformatrices d’éducation dans les communautés. Vous y lirez des chercheur-euse-s, des citoyen-ne-s impliqué-e-s dans la défense du système scolaire public et les groupes communautaires, des personnes racisées et autochtones en mouvement pour rendre visibles des enjeux qui nous concernent tous et toutes. Un survol vous est proposé dans ce dossier, certainement pas exhaustif, de certaines dimensions de la portée de l’éducation pour la quête de justice sociale. Nous exposons des bris de scolarisation pour les élèves en situation de handicap ou en difficulté d’adaptation ou d’apprentissage, et les discriminations freinant l’accès des jeunes à une éducation de qualité et propice à l’épanouissement. Les fonctions socialisantes de l’école et la place accordée aux perspectives critiques sont discutées tout comme les impacts de l’école à trois vitesses sur le droit à l’égalité. Nous apprenons davantage sur les questions liées à l’éducation et à la préservation et la valorisation des langues comme l’innuaimun et l’inuktitut. Les enjeux de discrimination et la marchandisation des étudiante- s internationaux, l’importance du droit à l’éducation pour les adultes ainsi que la participation à la démocratie scolaire, favorisant l’inclusion des familles immigrantes, sont aussi abordés. En dehors de l’école, d’autres lieux clés pour l’éducation propices à favoriser le développement de l’agir citoyen sont exposés pour démontrer la force de l’éducation autre que formelle. Nous espérons que vous ressortirez de la lecture du dossier avec une réflexion actualisée sur les liens entre éducation et droits humains. Bonne lecture !1. UNESCO, Ce qu’il faut savoir sur le droit à l’éducation, en ligne : https://www.unesco.org/fr/right-education/need-know

L’article L’éducation au coeur des possibilités est apparu en premier sur Ligue des droits et libertés.

L’avenir des droits

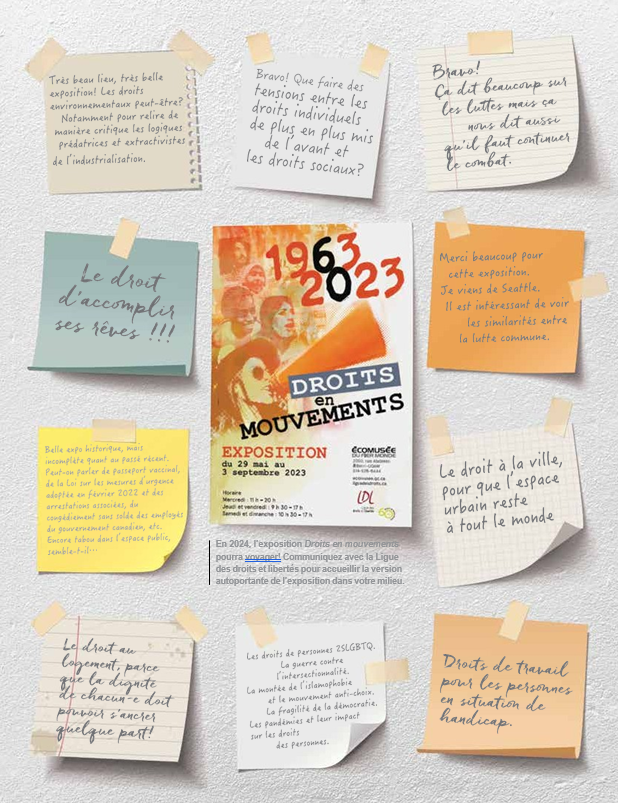

Les suites de l'Exposition Droits en mouvements

Organisée à l’Écomusée du fier monde à l’occasion du 60e anniversaire de Ligue des droits et libertés (LDL), l’exposition Droits en mouvements a été une formidable occasion de promouvoir les droits humains. [caption id="attachment_19587" align="aligncenter" width="510"] Exposition Droits en mouvements à l’Écomusée du fier monde à l’occasion du 60e anniversaire de la Ligue des droits et libertés, 2023. Crédit Daphnée Bouchard[/caption]

À la fin de l’exposition, un espace de cocréation a été aménagé comme un lieu de réflexion collective pour toutes les personnes qui, comme les militantes et militantes de Ligue des droits et libertés, s’efforcent de bâtir un projet de société fondé sur l’universalité, l’indivisibilité et l’interdépendance de tous les droits humains.

Comme mise au jeu, des questions ont été soumises autour des grands enjeux de demain, sur les droits davantage fragilisés de nos jours et ceux qui risquent d’être menacés à l’avenir, sur les luttes actuelles et prioritaires et sur les nouveaux droits à mettre de l’avant pour construire un monde moins injuste.

Exposition Droits en mouvements à l’Écomusée du fier monde à l’occasion du 60e anniversaire de la Ligue des droits et libertés, 2023. Crédit Daphnée Bouchard[/caption]

À la fin de l’exposition, un espace de cocréation a été aménagé comme un lieu de réflexion collective pour toutes les personnes qui, comme les militantes et militantes de Ligue des droits et libertés, s’efforcent de bâtir un projet de société fondé sur l’universalité, l’indivisibilité et l’interdépendance de tous les droits humains.

Comme mise au jeu, des questions ont été soumises autour des grands enjeux de demain, sur les droits davantage fragilisés de nos jours et ceux qui risquent d’être menacés à l’avenir, sur les luttes actuelles et prioritaires et sur les nouveaux droits à mettre de l’avant pour construire un monde moins injuste.

Article 28. Toute personne a droit à ce que règne, sur le plan social et sur le plan international, un ordre tel que les droits et libertés énoncés dans la présente Déclaration puissent y trouver plein effet. (Déclaration universelle des droits de l'homme)

Crise écologique, migrations forcées, croissance des inégalités Nord-Sud, saccage des services sociaux, brutalités policières, marginalisations de tous ordres, déni des droits des Autochtones, montée du racisme et des mouvements d’extrême-droite, développements des technologies de surveillance et de l’intelligence artificielle… Les nombreuses crises qui nous touchent actuellement, nous obligent à repenser nos luttes et à réfléchir à l’avenir des droits humains, au Québec comme à l’échelle mondiale.-

-

- Quels sont les grands enjeux de droits humains qui marqueront notre monde de demain ?

- Quels droits vous paraissent aujourd’hui fragilisés ?

- Quels sont ceux qui seront les plus menacés dans les années à venir ?

- Quelles luttes sont aujourd’hui prioritaires ou vous interpellent le plus, dans votre quotidien ?

- Quels nouveaux droits faut-il mettre de l’avant pour construire un monde moins injuste ?

-

Exposition itinérante - autoportante

Pour profiter de cette exposition historique sur les luttes pour les droits humains dans les cégeps, les universités, les milieux de travail, ou ailleurs, contactez-nous!L’article L’avenir des droits est apparu en premier sur Ligue des droits et libertés.

« Business as usual » ou la transition énergétique selon la CAQ

Retour à la table des matières Droits et libertés, automne 2023 / hiver 2024

Eric Pineault, professeur, Institut des sciences de l’environnement de l’UQAM et chercheur associé à la Chaire de recherche UQAM en transition écologique Quels seraient les contours d’une politique de transition si l’urgence climatique était prise au sérieux par le gouvernement du Québec ? Elle reposerait sur trois piliers. Le premier pilier serait la priorité à l’atteinte, voir au dépassement, des cibles de réduction de gaz à effet de serre (GES) et de protection de la biodiversité sur le territoire québécois. Nos politiques économiques et énergétiques seraient modelées en fonction de ces deux objectifs. Comme second pilier, il y aurait la participation de la population aux décisions structurantes pour atteindre ces cibles, à partir d’un débat public, vaste, structuré et franc — c’est à dire informé par la science — sur les trajectoires de transition possibles pour le Québec. Ce dialogue social sur les trajectoires de transition devrait également porter sur les changements socio-économiques qu’elles impliquent, ainsi que le type de politique énergétique qui en découle. Finalement, le troisième pilier serait l’accompagnement des communautés locales, villes, villages et municipalités régionales de comtés (MRC), dans la mise en oeuvre de stratégies de résilience socio-écologique et d’adaptation aux changements climatiques1. [caption id="attachment_18759" align="alignright" width="448"] Vue du site de Northvolt (CIL) à MCMasterville à partir du sommet Dieppe au Mont Saint-Hilaire, crédit : François Dupuis[/caption]

Vue du site de Northvolt (CIL) à MCMasterville à partir du sommet Dieppe au Mont Saint-Hilaire, crédit : François Dupuis[/caption]

Trois piliers

Le premier pilier implique à court terme d’introduire une conditionnalité écologique dans toutes les décisions économiques, énergétiques et écologiques de l’État, incluant ses programmes de subventions1. Compte tenu de l’urgence environnementale, cette conditionnalité doit primer sur les autres considérations. Le second pilier implique d’ouvrir un processus de dialogue social pour prendre en charge la transformation socioécologique de l’économie et de la société québécoise afin que la transition puisse être planifiée démocratiquement. C’est une mesure de moyen à long terme. Le troisième pilier permet aux gouvernements de proximité et aux communautés locales mobilisées d’agir maintenant pour transformer matériellement notre cadre de vie, nos modes de production et d’occupation du territoire. Évidemment, ce n’est pas de cette manière que s’organise la gouvernance de la transition écologique sous la Coalition avenir Québec (CAQ). Bien que ce gouvernement reconnaisse nominalement l’existence d’une urgence climatique, il aborde cette question, comme bien d’autres, avec une approche affairiste. La transition comme occasion d’affaires ? Cela semble résumer en quelques mots l’approche business as usual de la CAQ vis-à-vis des enjeux environnementaux.Northvolt donne le ton

L’annonce de l’accueil de l’entreprise suédoise Northvolt a donné le ton. D’un côté un investissement public substantiel dans une industrie stratégique pour la transition énergétique, de l’autre une révision des règles qui encadrent le Bureau d’audiences publiques sur l’environnement (BAPE) afin que ce projet échappe à une évaluation en bonne et due forme de ses impacts environnementaux. L’urgence climatique justifie, semble-t-il, l’état d’exception en matière de politique environnementale, même pour ce qui se présente comme le plus important projet industriel privé de l’histoire du Québec. Pourtant, des enjeux il y en a, particulièrement en matière d’impacts sur la biodiversité et les milieux humides. Le premier ministre du Québec voit dans l’arrivée de Northvolt, qui produira des batteries pour les constructeurs de véhicules électriques, un premier pas vers un retour de l’industrie de production de l’automobile au Québec. On pourrait dire que la transition écologique à la CAQ se résume à une grande occasion d’affaires. Notre dotation en hydroélectricité qui, sans être entièrement propre, est au moins renouvelable, sert d’appât à des grandes entreprises multinationales qui ont besoin d’énergie verte pour leurs procédés industriels. L’équipe économique de la CAQ, le ministre de l’Économie et de l’Énergie en premier, se promène d’un Davos à l’autre en promettant à qui veut l’entendre des futurs mégawatts à des prix plus que concurrentiels. Mégawatts que le Québec ne produit pas encore. La publication du plan d’action 2035 par Hydro-Québec confirme cette tendance dans la mesure où il privilégie l’augmentation de la production d’électricité sur la réduction planifiée de la demande et prévoit que le quart de ces nouveaux mégawatts seront destinés à la croissance industrielle.Une transition pour que rien ne change

Quels sont les éléments de cette politique de transition business as usual ? Elle tient dans les deux éléments qui composent l’expression : « comme d’habitude » et « affaires ». L’aveu par le premier ministre que son souhait ultime est d’attirer un constructeur d’automobiles électriques au Québec en dit long sur sa compréhension des changements à apporter à nos modes de vie, à l’organisation du territoire et aux manières de produire et de consommer dans la transition.La réponse est simple, on ne change rien, on n’a qu’à électrifier.

La transition est purement technologique, pour paraphraser Naomi Klein, tout va changer, mais rassurez-vous rien ne va changer. Alors que le Québec a déjà été un important producteur de matériel roulant pour le transport collectif, qu’il compte des entreprises engagées dans la production d’autobus électriques et de camions électriques, le premier ministre rêve d’une usine capable de produire des VUS made in Québec. En attendant, on peut être fier de fournir des batteries à l’usine du Michigan qui produit les E-Hummer. Le plan d’action d’Hydro-Québec pour 2035 est de la même trempe. Bien qu’Hydro augmente ses ambitions en efficacité énergétique, le plan ne fait pas de la réduction de la demande en énergie une pierre d’assise de sa stratégie. Il incarne ainsi dans la vision du gouvernement qu’il sera possible de tout décarboner ou presque en électrifiant et qu’il y en aura, en plus, pour les nouveaux projets industriels. Résultat, il faut prévoir ajouter de 8 000 à 9 000 mégawatts de plus d’ici 2035 en construisant de nouveaux grands complexes hydroélectriques dans le Nord et en tapissant le sud du Québec d’éoliennes. Et, même au terme de cet effort, on ne sera pas assez avancé dans la décarbonation. Le Québec continuera de brûler du gaz pour chauffer les bâtiments en période de pointe et on nous fait miroiter la possibilité de redémarrer la production d’énergie nucléaire.Alors qu’ailleurs la transition énergétique s’inscrit dans un vaste débat public impliquant la production et la discussion d’une gamme de scénarios alternatifs, ici le gouvernement continue de défendre les infrastructures de l’automobilité telles que le 3e lien et de faire l’apologie de l’étalement urbain.

Duplessisme énergétique

Affaires est le deuxième terme de notre expression. La transition réduite à sa plus simple itération — le développement de technologies qui mobilisent de l’électricité — c’est, aux yeux de la CAQ, autant de projets d’investissements privés. Le modèle de développement est bien rodé depuis les années 1950 : accueil de grandes entreprises industrielles étrangères à l’affut d’intrants à bas prix, environnement règlementaire allégé et prévisible, allégements fiscaux. Il fut un temps où c’était la main d’oeuvre et le minerai de fer, aujourd’hui les multinationales viennent chercher de l’énergie verte sous son coût marginal de production. Le tissu industriel du Québec et son système énergétique deviennent ainsi un point nodal, une étape, dans une longue chaine de valeur dont l’amont et l’aval nous échappent presque entièrement. Plutôt qu’un développement économique et industriel qui répond aux besoins de transition du Québec, celui-ci est largement organisé par des forces économiques externes et globales que le gouvernement se presse d’accommoder. La confusion est ainsi entretenue entre un soutien aux entreprises qui interviennent dans les technologies nécessaires à la décarbonation et la planification d’une transition viable au Québec. Est-ce que les batteries de Northvolt vont servir aux fabricants de véhicules de transport collectif au Québec ? Nul ne le sait. Quelle est la proportion de matériaux et de services que Northvolt va acheter aux PME québécoises ? Nul ne le sait. « Nous avons confiance dans le marché » nous répète le premier ministre, et c’est pourquoi la subvention de 2,9 milliards à l’entreprise vient sans obligation d’achat local. En fin de compte, ce n’est pas tant l’urgence climatique qui définit l’état d’exception justifiant la suspension de nos règles, mais plutôt l’urgence d’une occasion d’affaires à ne pas rater.1. En ligne : https://cffp.recherche.usherbrooke.ca/wp-content/uploads/2023/10/cr-2023-17_contreparties_vf.pdf

L’article « Business as usual » ou la transition énergétique selon la CAQ est apparu en premier sur Ligue des droits et libertés.

Contrer la banalisation et l’instrumentalisation des droits humains

Éditorial

Retour à la table des matières Droits et libertés, automne 2023 / hiver 2024

Alexandra Pierre, Présidente de la Ligue des droits et libertés Le 10 décembre 2023, la Déclaration universelle des droits de l’homme (sic) (DUDH) célèbre ses 75 ans. Ce document majeur, référence incontournable quand il s’agit de droits humains, affirme la dignité intrinsèque de chaque être humain et l’égalité en droits de tous et toutes. Dans les divers instruments relatifs aux droits humains, on souligne le fait que d’énoncer formellement ces droits n’est certainement pas suffisant. Il est nécessaire que les États honorent leurs obligations de les respecter, les protéger et de les mettre en oeuvre. En bref, que les États soient non seulement imputables, mais responsables des droits humains. [caption id="attachment_18681" align="alignright" width="448"] Contre-manifestation à la défense des jeunes trans - Laissez les enfants s'épanouir! 21 octobre 2023[/caption]

Dans ces instruments internationaux, la notion d’interdépendance est aussi incontournable : les différents droits sont liés les uns aux autres, et les progrès ou reculs sur certains droits ont un impact sur les autres droits. De même, on insiste sur le caractère indivisible des droits : les droits humains forment un ensemble cohérent qu’il faut défendre dans sa globalité, pas un menu à la carte dans lequel on prélève ce qui nous est utile.

Or, on observe une certaine banalisation, une instrumentalisation du cadre de référence des droits humains, et une mise en opposition de certains droits, à tort. Ces tendances mettent à mal les principes d’universalité, d’indivisibilité et d’interdépendance, et les obligations des États en matière de droits humains. À l’automne 2023[1], les communautés trans luttant pour le respect de leurs droits ont été la cible de dérapages dans le cadre des mobilisations de personnes opposées aux enseignements de la diversité sexuelle et de genre dans les écoles. Ces tentatives de fragmenter les droits et de les mettre en opposition les uns aux autres ne sont pas une nouveauté : les droits de l’enfant contre la liberté de conscience et de religion ; les droits des parents contre le droit à l’égalité et l’interdiction de discrimination fondée sur l’identité sexuelle et de genre ; le droit à la sécurité des enfants et adolescent-e-s trans et non binaires contre la liberté d’expression des personnes opposées à l’enseignement de la diversité, etc.

Pourtant, l’universalité, l’indivisibilité et l’interdépendance des droits doivent être prises en compte et servir de grille d’analyse pour jauger des impacts d’une politique, d’une opinion ou d’une revendication sur les personnes et les communautés, tout en tenant compte du contexte social et de l’exclusion subie par certains groupes.

Ainsi, invoquer la protection des enfants ou l’autorité parentale pour s’opposer à l’éducation sur les identités de genre et l’orientation sexuelle dans les écoles ne tient pas la route… La Convention relative aux droits de l’enfant (CRDE), ratifiée par le Québec et le Canada en 1991, souligne que les enfants sont des titulaires de droits à part entière, que ces enfants doivent pouvoir exercer leurs droits dans tous les aspects de leur vie, pas seulement à travers leurs parents ou tuteur-trice-s. Bien que les parents soient titulaires d’une autorité parentale, l’enfant lui-même a des droits, incluant le droit à la vie, au développement mental, émotionnel, cognitif, social et culturel, et le droit à l’éducation.

Dans une observation développée sur la même Convention, les États parties conviennent que l’éducation de l’enfant doit lui inculquer le respect des droits et libertés fondamentales, et des principes consacrés dans la Charte des Nations unies. De même, l’article 10 de la Charte québécoise des droits et libertés de la personne interdit toute discrimination fondée sur l’identité ou l’expression de genre, de même que sur l’orientation sexuelle.

Les personnes trans et non binaires sont titulaires de droits et ne peuvent être discriminées sur la base de leur genre. Bien que les parents puissent avoir en toute légitimité une opinion sur ce qui devrait être enseigné ou pas, et exprimer celle-ci, le climat des manifestations de septembre 2023, les fausses informations circulant sur les cursus scolaires et la soi-disant l’idéologie de genre contribuaient à exacerber la transphobie. Encore une fois, les droits humains ne sont pas une option et ils sont garantis à tous et toutes. Ils ne peuvent être applicables selon la tête du client ou au gré du vent. Les droits humains ne sont surtout pas des obstacles à la bonne morale, au gros bon sens, à la possibilité de s’exprimer ; ils incarnent des balises pour le respect de la dignité de toutes et tous.

Si on en revient au rôle des États, les droits humains ne devraient pas dépendre de volonté individuelle ou de la majorité, ou encore, de la possibilité d’y croire ou pas. Dans le même sens, les droits à l’égalité, à la dignité et à la sécurité des personnes trans et non binaires ne sont pas une question de croyance ou de choix individuel ou parental. Le Canada et le Québec ont des obligations en ce sens par leur ratification des instruments comme la DUDH et la CRDE.

Il faut admettre qu’il reste encore du pain sur la planche pour éduquer tout un chacun aux questions de genre et que la cadence sur ce plan doit s’accélérer. Les discussions peuvent être un moment intéressant d’apprentissage collectif, notamment sur l’universalité, l’indivisibilité et l’interdépendance des droits. Comme dans bien des cas, l’actualité nous offre une occasion de dialogues, mais cela doit se faire sans compromettre les droits et la dignité des personnes concernées.

Les droits ont beaucoup évolué depuis 1948, année de l’adoption de la DUDH, et ils sont appelés à poursuivre leur évolution. Il est plus nécessaire que jamais de contrer ces phénomènes de banalisation et d’instrumentalisation des droits humains pour poursuivre notre route collectivement vers une société respectueuse des droits et explicitement opposée aux discours transphobes et autres formes d’exclusion sociale et de discrimination.

Contre-manifestation à la défense des jeunes trans - Laissez les enfants s'épanouir! 21 octobre 2023[/caption]

Dans ces instruments internationaux, la notion d’interdépendance est aussi incontournable : les différents droits sont liés les uns aux autres, et les progrès ou reculs sur certains droits ont un impact sur les autres droits. De même, on insiste sur le caractère indivisible des droits : les droits humains forment un ensemble cohérent qu’il faut défendre dans sa globalité, pas un menu à la carte dans lequel on prélève ce qui nous est utile.

Or, on observe une certaine banalisation, une instrumentalisation du cadre de référence des droits humains, et une mise en opposition de certains droits, à tort. Ces tendances mettent à mal les principes d’universalité, d’indivisibilité et d’interdépendance, et les obligations des États en matière de droits humains. À l’automne 2023[1], les communautés trans luttant pour le respect de leurs droits ont été la cible de dérapages dans le cadre des mobilisations de personnes opposées aux enseignements de la diversité sexuelle et de genre dans les écoles. Ces tentatives de fragmenter les droits et de les mettre en opposition les uns aux autres ne sont pas une nouveauté : les droits de l’enfant contre la liberté de conscience et de religion ; les droits des parents contre le droit à l’égalité et l’interdiction de discrimination fondée sur l’identité sexuelle et de genre ; le droit à la sécurité des enfants et adolescent-e-s trans et non binaires contre la liberté d’expression des personnes opposées à l’enseignement de la diversité, etc.

Pourtant, l’universalité, l’indivisibilité et l’interdépendance des droits doivent être prises en compte et servir de grille d’analyse pour jauger des impacts d’une politique, d’une opinion ou d’une revendication sur les personnes et les communautés, tout en tenant compte du contexte social et de l’exclusion subie par certains groupes.

Ainsi, invoquer la protection des enfants ou l’autorité parentale pour s’opposer à l’éducation sur les identités de genre et l’orientation sexuelle dans les écoles ne tient pas la route… La Convention relative aux droits de l’enfant (CRDE), ratifiée par le Québec et le Canada en 1991, souligne que les enfants sont des titulaires de droits à part entière, que ces enfants doivent pouvoir exercer leurs droits dans tous les aspects de leur vie, pas seulement à travers leurs parents ou tuteur-trice-s. Bien que les parents soient titulaires d’une autorité parentale, l’enfant lui-même a des droits, incluant le droit à la vie, au développement mental, émotionnel, cognitif, social et culturel, et le droit à l’éducation.

Dans une observation développée sur la même Convention, les États parties conviennent que l’éducation de l’enfant doit lui inculquer le respect des droits et libertés fondamentales, et des principes consacrés dans la Charte des Nations unies. De même, l’article 10 de la Charte québécoise des droits et libertés de la personne interdit toute discrimination fondée sur l’identité ou l’expression de genre, de même que sur l’orientation sexuelle.

Les personnes trans et non binaires sont titulaires de droits et ne peuvent être discriminées sur la base de leur genre. Bien que les parents puissent avoir en toute légitimité une opinion sur ce qui devrait être enseigné ou pas, et exprimer celle-ci, le climat des manifestations de septembre 2023, les fausses informations circulant sur les cursus scolaires et la soi-disant l’idéologie de genre contribuaient à exacerber la transphobie. Encore une fois, les droits humains ne sont pas une option et ils sont garantis à tous et toutes. Ils ne peuvent être applicables selon la tête du client ou au gré du vent. Les droits humains ne sont surtout pas des obstacles à la bonne morale, au gros bon sens, à la possibilité de s’exprimer ; ils incarnent des balises pour le respect de la dignité de toutes et tous.

Si on en revient au rôle des États, les droits humains ne devraient pas dépendre de volonté individuelle ou de la majorité, ou encore, de la possibilité d’y croire ou pas. Dans le même sens, les droits à l’égalité, à la dignité et à la sécurité des personnes trans et non binaires ne sont pas une question de croyance ou de choix individuel ou parental. Le Canada et le Québec ont des obligations en ce sens par leur ratification des instruments comme la DUDH et la CRDE.

Il faut admettre qu’il reste encore du pain sur la planche pour éduquer tout un chacun aux questions de genre et que la cadence sur ce plan doit s’accélérer. Les discussions peuvent être un moment intéressant d’apprentissage collectif, notamment sur l’universalité, l’indivisibilité et l’interdépendance des droits. Comme dans bien des cas, l’actualité nous offre une occasion de dialogues, mais cela doit se faire sans compromettre les droits et la dignité des personnes concernées.

Les droits ont beaucoup évolué depuis 1948, année de l’adoption de la DUDH, et ils sont appelés à poursuivre leur évolution. Il est plus nécessaire que jamais de contrer ces phénomènes de banalisation et d’instrumentalisation des droits humains pour poursuivre notre route collectivement vers une société respectueuse des droits et explicitement opposée aux discours transphobes et autres formes d’exclusion sociale et de discrimination.

[1] Ligue des droits et libertés, Déclaration, La Ligue des droits et libertés préoccupée par la montée de la transphobie, 21 septembre 2023. En ligne : https://liguedesdroits.ca/la-ligue-des-droits-et-libertes-preoccupee-par-la-montee-de-la-transphobie/

L’article Contrer la banalisation et l’instrumentalisation des droits humains est apparu en premier sur Ligue des droits et libertés.

Tisser un projet de société

Tisser un projet de société

Laurence Guénette, Coordonnatrice à la Ligue des droits et libertésRetour à la table des matières Revue Droits et libertés, printemps / été 2023

L’avenir des droits économiques, sociaux et culturels (DESC) dépend en grande partie des efforts menés pour parvenir à une égale reconnaissance de tous les droits humains. Il est essentiel d’insister plus que jamais sur leur caractère d’indivisibilité, alors qu’ils ont longtemps été abordés en deux blocs, les droits civils et politiques (DCP), associés aux démocraties libérales et soigneusement séparés des droits économiques, sociaux et culturels qui eux, prédominaient dans le projet socialiste. Le modèle démocratique libéral qui domine dorénavant au niveau international persiste dans ses ironies et même ses hypocrisies, se félicitant de permettre la participation politique de gens qui peinent à subvenir à leurs besoins de base… un exemple de plus qui incite à mettre de l’avant l’interdépendance des droits !Les parents pauvres des droits

Ce rappel peut sembler suranné en 2023, et pourtant les DESC demeurent les parents pauvres des droits humains1. Les DESC sont résolument mis à mal par le néolibéralisme qui prédomine actuellement sans que cela paraisse trop intolérable dans l’opinion publique. La perspective des droits humains, profondément subversive, doit être mise de l’avant haut et fort, et soulignée dans son caractère non partisan et apolitique. La possibilité de m’instruire adéquatement ne dépend pas de l’opinion des élu-e-s, c’est un droit humain ! Le plein exercice de mon droit à la santé n’est pas tributaire des orientations politiques d’un-e ministre, c’est un droit humain ! Lors de la campagne électorale de l’automne 2022 et du débat des chef-fe-s, les droits économiques, sociaux et culturels étaient invisibles, jamais nommés, et pourtant ils étaient en filigrane de toutes les grandes crises auxquelles les candidat-e-s se proposaient de répondre. Ils étaient à la fois tus et instrumentalisés, présentés sous forme de promesses électorales partisanes et de services modulables selon leur bonne volonté politique. Comme le soulignait Christine Vézina dans une lettre ouverte publiée quelques jours après le scrutin et co-signée par la LDL, « la jouissance de droits économiques et sociaux, tels les droits au logement, à la santé, à l’éducation et à un niveau de vie suffisant ne devrait en aucun cas être conditionnelle aux aléas des gains électoraux. Elle devrait plutôt les transcender, conformément aux engagements auxquels le Québec a souscrit en 1976 lorsqu’il a lui- même ratifié le Pacte international relatif aux droits économiques, sociaux et culturels2 ».De graves reculs

Certaines crises à l’échelle du Québec et du Canada, de même que des crises à l’échelle mondiale, demeureront d’actualité dans les années à venir et sont propices à la défense et à la promotion des DESC. Pensons aux graves enjeux de logement, à la détérioration des services sociaux tels que le système de santé, ou encore aux crises du climat ou de la biodiversité affectant le droit à un environnement sain. Ces droits sont à la fois en proie à de graves périls ou reculs, et en même temps susceptibles de susciter d’importantes mobilisations. Certains DESC sont également mis à mal sans que cela ne soit aussi visibilisé dans le public, et pourtant les impacts sur d’autres droits humains sont multiples et graves. C’est le cas notamment du droit à l’information, essentiel à une participation démocratique réelle, car il représente une condition de la transparence, de la reddition de compte des élu-e-s et de la possibilité des citoyen-ne-s de prendre position et de se mobiliser pour différentes causes.L’interdépendance des droits

La LDL devra poursuivre ses efforts de partage et de promotion de la perspective des droits humains et favoriser la coalition des mouvements sociaux autour de diverses mobilisations, notamment en mettant de l’avant l’interdépendance des droits humains. Cette interdépendance nous invite à tenir compte des effets des violations ou de la réalisation des droits humains entre eux, et à exiger la justiciabilité de tous les droits, au-delà de la séparation entre les droits civils et politiques, d’une part, et les droits économiques sociaux et culturels, de l’autre, séparation artificielle que nous combattons sans relâche. Le PIDESC énonce dans son préambule que « l’idéal de l’être humain libre, libéré de la crainte et de la misère, ne peut être réalisé que si des conditions permettant à chacun de jouir de ses droits économiques, sociaux et culturels, aussi bien que de ses droits civils et politiques, sont créées ». De quelles conditions parle-t-on ? Les DESC sont les premiers mis en péril quand le néolibéralisme frappe, que l’austérité et la privatisation s’accentuent. La défense de ces droits exige de remettre en cause sans relâche la dangereuse perspective selon laquelle l’individu est responsable de sa propre condition socioéconomique, et dès lors responsable de son échec à accéder à des services permettant une mise en œuvre complète de ses droits. En effet, cette vision méritocratique, combattue depuis longtemps, mais encore dominante malgré tout, suggère que si une personne ne parvient pas à faire réparer ses dents ou à se louer un appartement décent, c’est principalement en raison de mauvais choix qu’elle a faits ou d’opportunités qu’elle n’a pas su saisir.La précarité socioéconomique

Dans un rapport publié en 2022, Olivier de Schutter, Rapporteur spécial sur les droits de l’homme et l’extrême pauvreté aux Nations Unies, soulignait la pertinence de reconnaitre la précarité socioéconomique comme facteur de discrimination à interdire3.Il rappelle cette précarité comme « un processus dans lequel les privations multiples se renforcent mutuellement et sont associées à la stigmatisation, la discrimination, l’insécurité et l’exclusion sociale ». La précarité socioéconomique peut également nous servir à remettre en question la perception de la pauvreté comme étant une défaillance de l’individu, sur qui reposerait donc le fardeau de la pauvreté. Elle invite naturellement à insister sur le droit de tout être humain à la dignité et à la satisfaction de ses besoins de base, et à tenir compte de l’interdépendance des droits. Un niveau de vie insuffisant a des impacts évidents sur d’autres droits ; à l’inverse, les reculs en matière d’éducation publique, de santé publique ou de droit au logement contribuent à perpétuer la précarité des personnes et donc à les empêcher de jouir de leur droit à un niveau de vie suffisant. La notion de précarité socioéconomique suppose non seulement d’interdire toute discrimination fondée sur la condition socioéconomique des personnes, mais suggère également la nécessité de combattre les inégalités. Car les violations des droits économiques et sociaux sont le résultat de comportements concrets d’entités privées ou publiques violant ces droits, et de gouvernements omettant de les protéger adéquatement et de les mettre en œuvre pleinement. Les gouvernements et les groupes caritatifs mettent souvent l’accent sur la pauvreté et les actions pouvant la soulager en partie, sans jamais parler des riches, ou presque, ni de la structure économique qui engendre la pauvreté. Même lorsqu’on nous parle d’inégalités, allégeant quelque peu la responsabilité individuelle de la précarité, on entend rarement dénoncer haut et fort la mauvaise redistribution de la richesse.Changer l’ordre établi

Pourtant, dans une perspective de droits humains, on ne peut pas faire l’économie de mettre en lumière les détentrices et détenteurs de la richesse et les élites qui tentent de préserver le statu quo, faisant obstacle aux mesures de protection et de mise en œuvre des droits humains, particulièrement des droits économiques, sociaux et culturels. Les luttes pour ces droits ne peuvent qu’être menées simultanément à des efforts pour défendre les services publics et les programmes sociaux universels. Défendre les DESC semble également devenir de plus en plus indissociable de la production et de la diffusion d’analyses critiques du système économique et des politiques fiscales et budgétaires qui en affectent la mise en œuvre. L’excellent rapport produit par la LDL en 2020 sur les façons dont les politiques fiscales impactent le droit à un niveau de vie suffisant et plusieurs autres droits humains va dans ce sens4. On gagne donc à poursuivre ces analyses conjointes et à encourager les collaborations entre économistes progressistes, par exemple, et mouvements pour les droits humains. La vigilance à l’égard des droits se trouvant au cœur de la participation démocratique demeurera également nécessaire dans l’avenir. L’État est responsable d’assurer le respect, la protection et la mise en œuvre de tous les droits humains, alors que les élu-e-s sont incités à favoriser les intérêts de groupes puissants agissant pour le profit du secteur privé. Les droits humains peuvent ainsi servir à poser un regard critique sur le lobbyisme, et, plus largement, sur les modalités de la participation démocratique qui nous sont proposées : les embûches dans l’accès à l’information, les lacunes et les hypocrisies de certains mécanismes de consultation publique, la fomentation d’une prétendue acceptabilité sociale, etc. Cent fois, sur le métier… remettez votre ouvrage, et continuons la lutte ! La LDL devra poursuivre son travail de défense des DESC en s’emparant de tout le potentiel analytique et mobilisateur proposé par l’interdépendance des droits humains.- En ligne : https://www.cdpdj.qc.ca/storage/app/media/publications/bilan_charte_etude_5.pdf

- En ligne : https://www.ledevoir.com/opinion/idees/761817/idees-un-peu-de-hauteur-s-il-vous-plait

- En ligne : https://digitallibrary.un.org/record/3983713/files/A_77_157-pdf?ln=fr

- Rapport Le droit à un niveau de vie Faut-il s’inquiéter lorsque le rapport d’impôt s’en mêle?, Ligue des droits et libertés, mars 2020.

L’article Tisser un projet de société est apparu en premier sur Ligue des droits et libertés.

Cent fois sur le métier…

Cent fois sur le métier...

Me Lucie Lamarche, Professeure en sciences juridiques, UQÀM et membre du conseil d’administration de la LDLRetour à la table des matières Revue Droits et libertés, printemps / été 2023